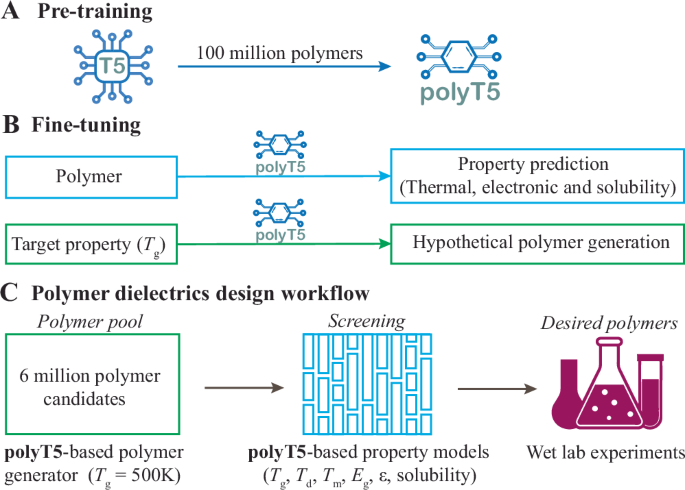

Une nouvelle approche permet de s’affranchir de l’énumération exhaustive de structures en utilisant POLYT5, un modèle de langage fondationnel de type encodeur-décodeur pré-entraîné sur plus de cent millions de structures macromoléculaires. En s’appuyant sur la notation SELFIES et l’intégration d’atomes d’astate comme marqueurs de terminaison, ce transformateur capture les dépendances chimiques bidirectionnelles et les relations structurelles à longue portée indispensables à la compréhension de l’architecture polymère. Le mécanisme de pré-entraînement par masquage de segments confère au modèle une capacité duale : la prédiction de propriétés physico-chimiques, telles que la température de transition vitreuse ou la constante diélectrique, et la conception inverse conditionnée par des objectifs de performance. Appliquée à la recherche de matériaux diélectriques, cette méthodologie a généré plus de six millions de candidats, filtrés selon des critères de largeur de bande interdite, de stabilité thermique et de processabilité. L’efficacité de ce protocole a été confirmée par la synthèse expérimentale d’un polymère dont les caractéristiques mesurées corroborent les prédictions numériques, validant ainsi un flux de travail accéléré par l’intelligence artificielle. Cette avancée technologique, intégrée à une interface conversationnelle, facilite l’exploration du vaste espace chimique pour le développement de dispositifs électroniques et de stockage d’énergie de nouvelle génération.

Actualités

- Les présentations de l’Atelier de Veille et Prospective 2026 sont disponibles !

- PhD Offer : Production of monodisperse nanometric coacervates and their use as mRNA non-viral vectors for the treatment of vascular complications – Institut Charles Sadron in Strasbourg, France (28/03/2026)

- PhD offer : Design of thermoresponsive comb polymers for the treatment of cancer – Institut Charles Sadron in Strasbourg, France (28/03/2026)

- PhD Opening : Self-HeAling Polymers Electrolytes for high performance, safe and sustainable-by design solid-state microbatteries – UGA (Univ. Grenoble Alpes, France) avec séjour à l’UdeS (Université de Sherbrooke, Canada)

- Conception d’une architecture polymère hybride photocatalytique pour la purification des eaux